Sztuczna Inteligencja w praktyce: Zastosowania i najnowsze trendy w obszarze AI

Spis treści

Stworzenie terminu „sztuczna inteligencja” SI (czy też AI od ang. artificial intelligence) przypisuje się Johnowi McCarthy’emu, wybitnemu amerykańskiemu informatykowi, który po raz pierwszy użył go na konferencji w Dartmouth College w 1956 roku. Historia myślących urządzeń sięga jednak o wiele dalej…

Krótko o długiej historii sztucznej inteligencji

Wizje maszyn, których funkcjonowanie naśladowałoby ludzki intelekt, snuto od niepamiętnych czasów, lecz ze względu na oczywiste ograniczenia techniczne przez wiele stuleci pozostawały one w sferze marzeń. Co nie znaczy, że nie nadrabiano wyobraźnią! Starożytnej Krety miał ponoć bronić odlany z brązu olbrzym Talos, a w tradycji żydowskiej funkcjonują legendy o golemach, glinianych człekokształtnych istotach, wprawdzie niemych i pozbawionych własnej woli, lecz zdolnych do rozumienia i wykonywania poleceń. Na przestrzeni wieków podejmowano próby konstruowania wymyślnych urządzeń, które udawały, że potrafią myśleć. Słynnym przykładem takiego „automatu” jest mechaniczny Turek; skomplikowana maszyneria zbudowana w drugiej połowie XVIII wieku przez Wolfganga von Kempelena, która miała ponoć znakomicie opanować grę w szachy. W rzeczywistości sterował nią ukryty wewnątrz przemyślnego mebla szachista, który w pocie czoła (czemu nie pomagało przyświecanie sobie świeczką) sterował mechanicznym ramieniem skądinąd całkiem skomplikowanej kukły.

Prawdziwym krokiem milowym na drodze do opracowania SI, czy też raczej jej matematycznych podstaw, były dziewiętnastowieczne dokonania Charlesa Babbage’a i Ady Lovelace w zakresie tworzenia urządzeń i rozwiązań będących prekursorami dzisiejszych komputerów i języków programowania. Maszyna analityczna Babbage’a, choć ostatecznie nie powstała, miała być napędzana silnikiem parowym i zostać wyposażona w coś na kształt „magazynu” i „jednostki obliczeniowej” – podzespołów zdumiewająco podobnych koncepcyjnie do dzisiejszych pamięci i procesorów. Wędrując przez czas ku epoce już całkiem nam bliskiej, nie sposób też nie wspomnieć o osiągnięciach Marvina Minsky’ego, twórcy jednej z pierwszych „samouczących” się maszyn, a ściślej rzecz biorąc małej sieci neuronowej, zbudowanej przy użyciu lamp elektronowych.

Wiek dwudziesty przyniósł nie tylko dalsze przełomy pod względem rozwoju koncepcji prowadzących do powstania SI, lecz także rozkwit książkowych i filmowych wizji sztucznej inteligencji, który podsycał masową wyobraźnię. Mało kto nie kojarzy krwistego spojrzenia Terminatora albo czerwonego oka kamery komputera HAL 9000 z filmu 2001: Odyseja kosmiczna (najwyraźniej z czerwonymi oczami coś jest na rzeczy; być może SI też czasami miewa marne noce). Ponieważ rozwój nauki coraz śmielej gonił popkulturowe wizje, badacze zaczęli się zastanawiać, jak sprawdzić, czy maszyna rzeczywiście przejawia inteligencję podobną do ludzkiej. Jeden z pierwszych testów, które to badały, nazwany testem Turinga od nazwiska jego pomysłodawcy, Alana Turinga (postaci również niezwykle zasłużonej dla rozwoju informatyki i sztucznej inteligencji), został zaproponowany w 1950 roku. Na podstawie rozmów prowadzonych pisemnie z człowiekiem i z maszyną miał on dawać odpowiedź na pytanie, czy maszyna udziela odpowiedzi nieodróżnialnych od tych, jakie mógłby podać człowiek. Jak wynika z badania opublikowanego w lutym bieżącego roku na łamach czasopisma naukowego „PNAS”, model ChatGPT wyszedł z tego testu obronną ręką.

Sztuczna inteligencja – zastosowania i trendy

Nie ulega wątpliwości, że SI wkracza w coraz więcej dziedzin życia. O wielu jej zastosowaniach, na przykład w obszarze medycyny i finansów, wspominałem wcześniej we wpisie dotyczącym uczenia maszynowego. Przyjrzyjmy się jeszcze kilku przykładom.

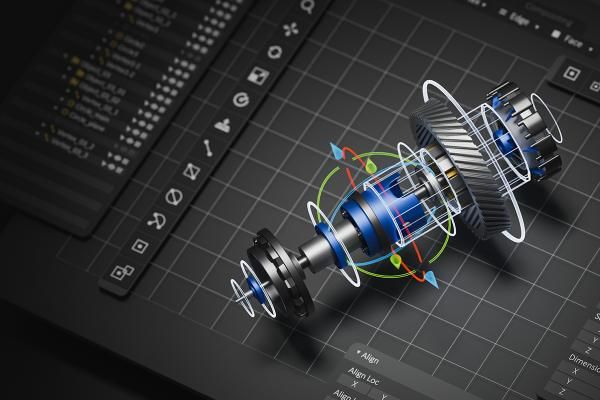

- Robotyka i systemy autonomiczne. Czeski pisarz Karel Čapek być może nawet się nie spodziewał, jak popularne stanie się słowo „robot”, którym nazwał sztucznych ludzi w swoim dramacie fantastycznonaukowym R.U.R. Dziś trudno sobie wyobrazić świat bez różnego rodzaju autonomicznych systemów, które znajdują coraz szersze zastosowanie w przemyśle i szeroko pojętej codzienności. Urządzenia wyposażone w SI wkraczają coraz śmielej do naszych domów i na ulice. Czy wkrótce czeka nas przesiadka do pojazdów autonomicznych? Koncepcja ta wciąż budzi powszechne obawy, lecz historia motoryzacji podsuwa przykłady innych lęków, związanych z postępem technicznym: sto pięćdziesiąt lat temu w Wielkiej Brytanii przed omnibusami biegł człowiek z czerwoną chorągiewką, który miał przed nimi ostrzegać innych użytkowników drogi.

- Zastosowania multimedialne. Duże modele językowe, takie jak GPT, a także generatory obrazu i innych rodzajów treści, wspomagają twórców w wielu dziedzinach, od muzyki, przez grafikę i słowo pisane, aż po elektroniczną rozrywkę. Umiejętnie stosowana SI wzbogaca postacie i światy gier komputerowych, a także ułatwia ich tworzenie. Także i w tym przypadku nietrudno o wątpliwości natury etycznej, granica między posługiwaniem się SI jako inspiracją i narzędziem a naruszaniem praw autorskich jest bowiem bardzo cienka.

- W nawiązaniu do poprzedniego punktu oraz wcześniejszej wzmianki o filmowych wizjach SI, wrócę do dziesiątej muzy, do której sztuczna inteligencja wkroczyła niejako od drugiej strony ekranu. Coraz częściej wykorzystuje się ją już nie tylko jako narzędzie ułatwiające tworzenie efektów specjalnych, kreowanie wiarygodnie wyglądających postaci czy kolorowanie czarno-białych klasyków filmowych, lecz także jako wsparcie dla scenarzystów, co budzi zrozumiałe kontrowersje.

- Konwersacyjna SI. Rozwiązania tego rodzaju coraz częściej trafiają do systemów obsługi klienta, chatbotów i asystentów, takich jak Alexa czy Siri. Dzięki zaawansowanym algorytmom rozpoznawania i generowania tekstu oraz mowy, możemy coraz swobodniej, choć wciąż nie bez mniej lub bardziej zabawnych słownych lapsusów, rozmawiać z wirtualnymi pomocnikami.

- SI dla… SI. W najbliższej przyszłości możemy się spodziewać postępującej automatyzacji rozwoju samych modeli sztucznej inteligencji. Innymi słowy, SI będzie coraz mocniej wspierać doskonalenie samej siebie.

- Ze względu na lawinowy rozwój systemów SI, rośnie zainteresowanie etycznymi aspektami ich zastosowania. W czysto hipotetycznym wymiarze zastanawiał się nad nimi już pisarz i autor książek science fiction Isaac Asimov, który w 1942 roku sformułował trzy prawa robotów. Obecnie wielu komentatorów podnosi kwestie potencjalnego manipulowania przez SI opinią publiczną, szerzenia dezinformacji czy wpływania na procesy demokratyczne. Padają pytania o to, kto tak naprawdę odpowiada za decyzje podejmowane przez sztuczną inteligencję i w jaki sposób chronione są ogromne ilości informacji, często osobistych, które służą jako źródła danych do trenowania jej modeli. Te i wiele innych pytań domagają się odpowiedzi, niezbędnych, aby rozwój i zastosowania SI opierały się na solidnym fundamencie etycznym.

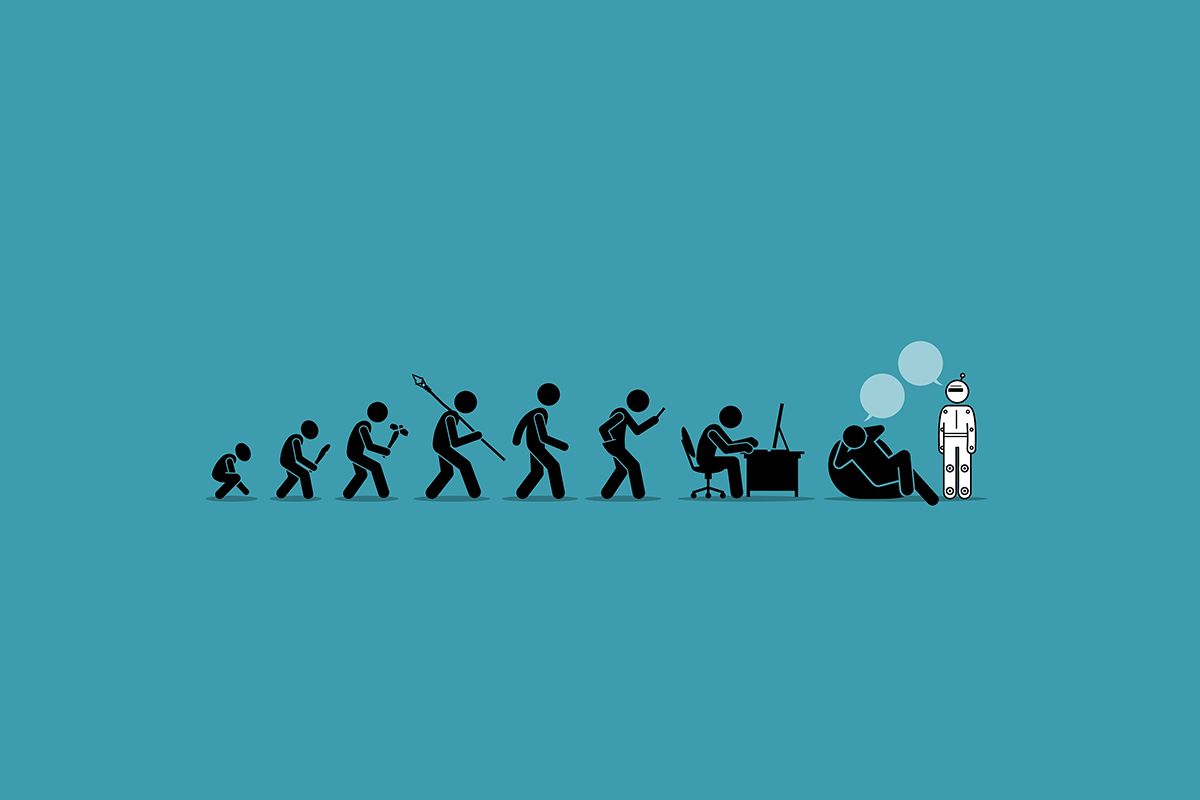

Niektórzy spekulują, że rozwój systemów sztucznej inteligencji może przyspieszyć tak bardzo, że w pewnym momencie przewyższą one intelektem ludzi, a co za tym idzie zaczną tworzyć coraz sprawniejsze i doskonalsze wersje samych siebie. Mogłoby to doprowadzić do lawinowego postępu technicznego, którego następstwa są nie do przewidzenia. Moment, w którym to nastąpi, jest niekiedy nazywany osobliwością technologiczną (ang. singularity), a naukowcy i futuryści tacy jak Raymond Kurzweil przewidują, że mogłoby do niego dojść mniej więcej w 2045 roku. Czy tak się stanie? Zagadnąłem o to ChatGPT, lecz uzyskałem wymijającą odpowiedź… ;-)

Zobacz nasze propozycje

-

- Druk

- PDF + ePub + Mobi

(35,40 zł najniższa cena z 30 dni)

38.35 zł

59.00 zł (-35%) -

- Druk

(29,94 zł najniższa cena z 30 dni)

32.43 zł

49.90 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(47,40 zł najniższa cena z 30 dni)

51.35 zł

79.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(29,40 zł najniższa cena z 30 dni)

31.85 zł

49.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(101,40 zł najniższa cena z 30 dni)

109.85 zł

169.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(77,40 zł najniższa cena z 30 dni)

83.85 zł

129.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(40,20 zł najniższa cena z 30 dni)

43.55 zł

67.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(53,40 zł najniższa cena z 30 dni)

57.84 zł

89.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(41,40 zł najniższa cena z 30 dni)

44.85 zł

69.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(29,40 zł najniższa cena z 30 dni)

29.40 zł

49.00 zł (-40%) -

- Druk

- PDF + ePub + Mobi

(47,40 zł najniższa cena z 30 dni)

51.35 zł

79.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(71,40 zł najniższa cena z 30 dni)

77.35 zł

119.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(41,40 zł najniższa cena z 30 dni)

44.85 zł

69.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(59,40 zł najniższa cena z 30 dni)

64.35 zł

99.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(40,20 zł najniższa cena z 30 dni)

43.55 zł

67.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(41,40 zł najniższa cena z 30 dni)

44.85 zł

69.00 zł (-35%) -

- Druk

- PDF + ePub + Mobi

(32,94 zł najniższa cena z 30 dni)

35.69 zł

54.90 zł (-35%)